Os verificadores de fatos do Reino Unido estão enviando sua IA para ajudar os americanos a cobrir as eleições

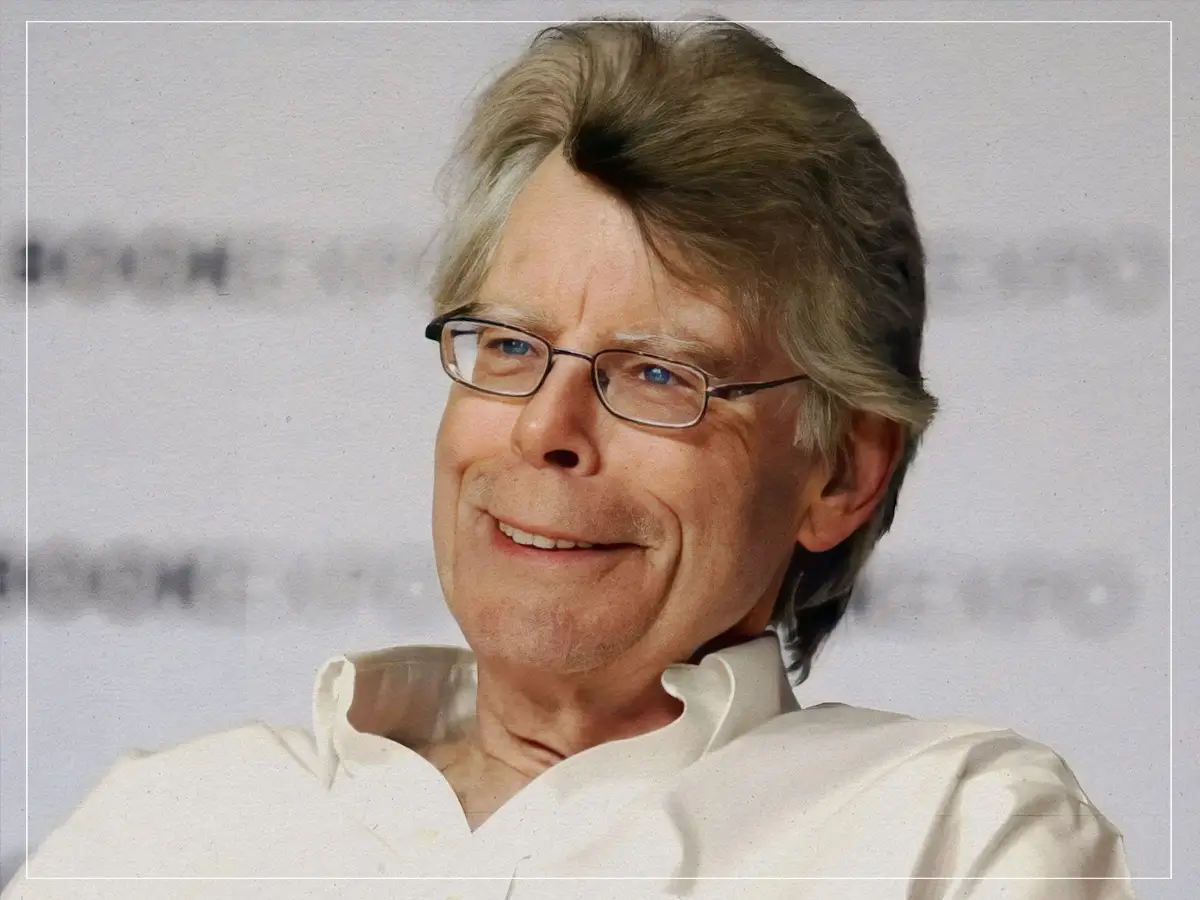

A partir da esquerda: Andy Dudfield, chefe de IA da Full Fact, gerente de produto sênior, Kate Wilkinson, e cientista de dados sênior, David Corney. (Cortesia de Fato Completo)

A partir da esquerda: Andy Dudfield, chefe de IA da Full Fact, gerente de produto sênior, Kate Wilkinson, e cientista de dados sênior, David Corney. (Cortesia de Fato Completo)Dentro de um modesto escritório perto da Ponte de Londres, uma pequena equipe de engenheiros e verificadores de fatos passou uma década refinando ferramentas e modelos de IA para fazer o que a maioria dos jornalistas não consegue mais fazer: acompanhar. O sistema lê as manchetes, transcreve as transmissões e verifica as mídias sociais em busca de afirmações que valham a pena verificar. Ele sinaliza aqueles com maior probabilidade de enganar ou causar danos.

A tecnologia desenvolvida pela Full Fact, a principal instituição de caridade de verificação de factos do Reino Unido, está a atravessar o Atlântico. Antes das eleições intercalares de 2026 nos EUA, que muitos especialistas em desinformação esperam que sejam definidas por falsidades criadas pela IA, a Full Fact está a convidar as redações americanas a testar as suas ferramentas enquanto procura financiamento para expandir o seu trabalho nos EUA.

Fundada em 2009, a Full Fact começou a fazer experiências com tecnologia muito antes de grandes modelos de linguagem capturarem a atenção global. Em 2016, os seus líderes perceberam que os verificadores de factos humanos já não podiam monitorizar todas as emissões ou plataformas em busca de alegações questionáveis sobre questões de interesse público. Quando Andy Dudfield ingressou na organização em 2019 para liderar o trabalho de IA, ele encontrou uma pequena equipe já explorando como a automação pode ajudar.

A tecnologia da Full Fact surgiu do processamento inicial de linguagem natural, antes dos modelos generativos de hoje. A equipe começou treinando sistemas para identificar declarações verificáveis e combiná-las com verificações de fatos existentes. Em 2019, os engenheiros aperfeiçoaram o BERT do Google – um modelo construído para compreender a linguagem em vez de gerá-la – para rotular os tipos de declarações em notícias e mídias sociais.

Com dezenas de milhares de anotações humanas, o modelo aprendeu a fazer a triagem de vastos fluxos de texto, processando mais de 300.000 frases por dia e sinalizando novas afirmações que reapareceram com palavras diferentes. Nos últimos dois anos, modelos generativos maiores juntaram-se ao conjunto, estimando danos potenciais e capturando versões parafraseadas que os sistemas antigos não perceberiam. Os novos sistemas revelam e agrupam informações falsas prováveis prejudiciais e os verificadores de factos decidem o que investigar e publicar.

Os usuários acessam as ferramentas por meio de um painel da web que exibe reivindicações de notícias, podcasts de mídia social, vídeo e rádio. A interface vincula-se a clipes ou postagens originais e permite que as equipes pesquisem por tópico ou palestrante, vejam onde as reivindicações apareceram e recebam alertas quando declarações desmentidas reaparecem. Se ativado, o sistema pode priorizar reivindicações prováveis prejudiciais para que os editores possam decidir no que trabalhar primeiro.

filho de snoop dogg

Tudo o que construímos em tecnologia é do ponto de vista de ser construído por verificadores de fatos para verificadores de fatos, disse-me Dudfield. Não estávamos tentando descobrir o que a tecnologia poderia fazer que seria legal. Estávamos tentando descobrir os problemas reais que tínhamos com a verificação de fatos e ver se a tecnologia poderia ajudar.

Essa distinção moldou a Full Fact AI, agora uma equipe de oito pessoas no centro do trabalho da instituição de caridade. O sistema analisa o dano potencial de uma reclamação, avaliando o quão errada ela é, quão verossímil ela soa e qual a probabilidade de levar as pessoas a agirem de acordo com ela.

O modelo de danos baseia-se na pesquisa de Peter Cunliffe-Jones, fundador da Africa Check e autor de Fake News: What’s the Harm? Nesse livro publicado pela University of Westminster Press, Cunliffe-Jones traça como as falsidades podem desencadear consequências mensuráveis – desde ataques de multidões a profissionais de saúde durante o surto de Ébola de 2014 até linchamentos na Índia alimentados por boatos no WhatsApp sobre raptores de crianças. Entre 2021 e 2025, ele desenvolveu um modelo para prever quais alegações falsas tinham maior probabilidade de causar danos reais.

Os verificadores de fatos precisam se concentrar no que tem maior probabilidade de causar danos reais, e não apenas no que há de errado que Cunliffe-Jones me disse por e-mail. A estrutura de pontuação de danos do Full Fact aplica esse modelo em escala, ajudando os verificadores de fatos a direcionar recursos limitados para onde eles são mais importantes.

As ferramentas foram utilizadas por mais de 40 organizações de verificação de factos em mais de 30 países, incluindo durante as eleições presidenciais de 2023 na Nigéria, onde verificadores de fatos os empregaram para rastrear e desmascarar alegações virais em tempo real . O sistema é uma co-inteligência entre humano e máquina, disse Kate Wilkinson Full Fact, gerente sênior de produto, que está liderando a divulgação nas redações dos EUA.

Nossas ferramentas não foram projetadas para substituir os verificadores de fatos, disse Wilkinson. Eles eliminam a tarefa de monitoramento de mídia que exige muito tempo e recursos.

A Full Fact começou a convidar escritórios de verificação de fatos dos EUA, de equipes locais a redes nacionais, para testar suas ferramentas de IA antes das eleições do próximo ano. Wilkinson considerou o momento apropriado e disse que a plataforma poderia ajudar as redações a lidar com as reivindicações eleitorais em grande escala, sem adicionar pessoal de engenharia. A implementação inclui licenças subsidiadas e breves sessões de integração para ajudar as equipes a integrar rapidamente as ferramentas em seu trabalho diário.

A mudança ocorre no momento em que muitas redações independentes e sem fins lucrativos enfrentam dificuldades financeiras crescentes enquanto experimentam como a IA pode ajudá-las a atender melhor seu público. Nos Estados Unidos Meta terminou o seu programa de verificação de factos por terceiros, em Janeiro, forçou vários meios de comunicação a reduzirem a sua escala e levou ao encerramento de quase um terço das organizações acreditadas pela Rede Internacional de Verificação de Factos.

sara matter

Há duas semanas, a Full Fact divulgou que o Google retirou seu apoio de longa data ao trabalho de IA da instituição de caridade. A organização disse que recebeu mais de £ 1 milhão do Google no ano passado, diretamente ou por meio de fundos relacionados, todos os quais foram descontinuados.

Dudfield considerou a perda significativa, mas não intransponível. A tecnologia não é algo que fazemos paralelamente na Full Fact, disse ele. É fundamental para o que fazemos.

Em comunicado, o executivo-chefe da Full Fact, Chris Morris, disse que a instituição de caridade está reorientando urgentemente sua arrecadação de fundos, mantendo-se independente. Morris, o primeiro verificador de fatos no ar da BBC, também criticou o que descreveu como um arrepio político no Vale do Silício. Acreditamos que as decisões do Google e de outras grandes empresas de tecnologia dos EUA são influenciadas pela necessidade percebida de agradar a atual administração dos EUA. escreveu . Os factos completos serão sempre claros: os factos verificáveis são importantes e as grandes empresas da Internet têm responsabilidades quando se trata de reduzir a propagação de desinformação prejudicial.

Os cortes de financiamento seguem uma recuo mais amplo das principais empresas de tecnologia de apoiar a verificação de factos a nível mundial. Dudfield disse que o ambiente em mudança reforçou a missão da sua equipe de usar a tecnologia para sustentar a verificação independente. Continuaremos a utilizar a tecnologia para apoiar a verificação de factos porque acreditamos que é aí que podemos fazer a maior diferença, disse ele.

A expansão da Full Fact chega em um momento crucial para a verificação de fatos, disse Lucas Graves, professor de jornalismo da Universidade de Wisconsin-Madison e autor de Decidindo o que é verdade: a ascensão da verificação de fatos políticos no jornalismo americano.

Há muitas experiências com IA acontecendo em todo o cenário da mídia nos EUA, em redações grandes e pequenas, disse ele. Mas o que a Full Fact tem é uma plataforma desenvolvida especificamente ao longo de quase uma década para rastrear e priorizar a desinformação – uma área onde a maioria das redações não tem muita experiência.

Graves considerou a expansão oportuna, acrescentando que a ameaça da desinformação online está evoluindo rapidamente, enquanto os recursos das redações continuam a diminuir.

Apesar das mudanças políticas e do declínio do apoio à indústria, Dudfield disse que o objetivo não mudou. Somos verificadores de fatos. Verificamos os fatos, ele disse. O trabalho de expor falsidades, acrescentou, continua a ser essencial, mesmo com o aumento das pressões sobre os jornalistas independentes. A alternativa, ele disse, custaria muito mais.